The overview of this paper

LLM은 fine-tune 하는데 광범위한 supervision을 필요로 하는 반면에 사람은 외부적 입력 없이 self-thinking을 함으로써 추론 능력을 향상시킬 수 있다. 이 논문에서는 LLM도 오직 unlabeled dataset만을 사용하여 self-improve 할 수 있다는 것을 설명한다. 논문에서는 CoT prompting과 Self-Consistency를 사용해서 unlabeled question에 대한 'high-confidence' ratinoale-augmented answer를 생성하기 위해 PLM을 사용하고 이 self-generated solution을 이 self-generated solution을 타깃 output으로 해서 LLM을 fine-tune 한다. 논문의 실험에서는 어떠한 ground-truth 라벨 없이 540B-parameter LLM의 추론 능력을 향상시켜서 SoTA를 달성했다.

Table of Contents

1. Introduction

2. Method

3. Experimental Setup

4. Results

1. Introduction

대규모 텍스트 corpus에서 학습된 모델의 놀라운 능력에도 불구하고, 근본적으로 few-shot baseline 모델의 성능을 향상시키는 것은 아직 광범위한 양의 high-qulaity supervised 데이터셋에서의 fine-tuning을 필요로 한다. 이 high-quality 데이터를 수집하기 위한 상당한 노력이 있었던 반면에, 메타인지 프로세스에서는 high-quality 데이터를 많이 수집해서 외부 입력 없이 스스로 추론 능력을 개선할 수 있다.

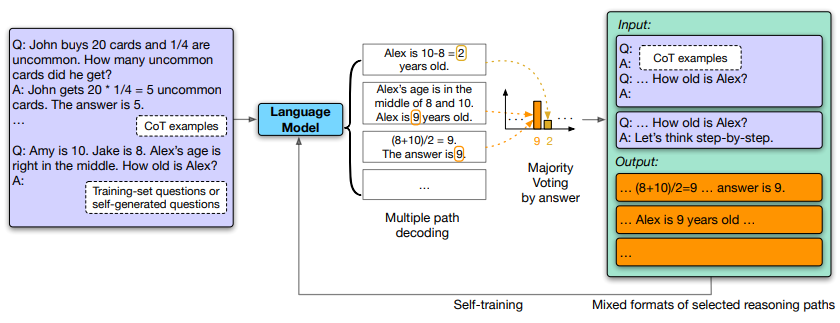

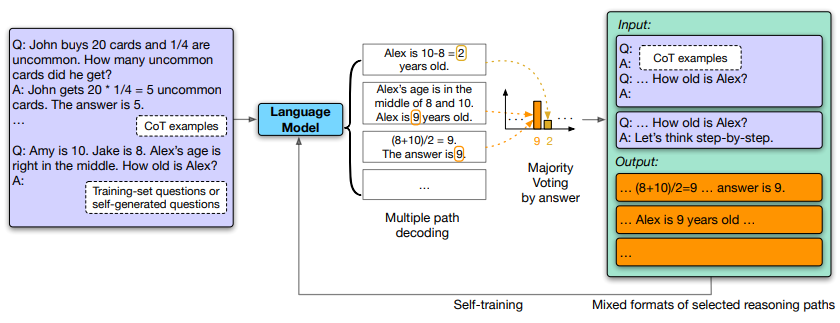

이 논문에서는 LLM이 어떻게 supervised data 없이 이들의 추론 능력을 self-improve 할 수 있었던 것인지에 대해 연구하였다. 논문에서는 오직 다양한 NLP task 데이터셋으로부터의 입력 시퀀스만을 사용해서 PLM이 in-domain & out-of-domain task 모두에 대해 성능을 향상시킬 수 있다는 것을 보여주었다. 논문에 사용된 method는 그림 1에 나타나 있고, 그 과정은 다음과 같다.

- few-shot CoT를 prompt로 사용해서 다양한 예측을 샘플링함

- high-confidence 예측을 majority voting(Self-Consistency)를 사용해서 필터링

- 이 high-confidence 예측에서 LLM을 fine-tune함

결과로 나온 모델은 greedy & multi-path 평가 모두에서 개선된 추론을 보여준다. 논문에서는 이런 방식으로 fine-tune 된 모델을 Language Model Self-Improved(LMSI)라고 이름 붙였다. 이 방식은 사람의 뇌가 학습하는 방법과 유사하다.

논문의 contribution은 다음과 같다:

- LLM은 ground-truth output 없이 CoT 추론을 활용함으로써 self-improve 할 수 있다. 또한 유망한 in-domain multi-task 성능뿐만 아니라 out-of-domain 일반화도 달성할 수 있다는 것을 설명한다.

- training 포맷팅과 샘플링 포맷팅에 대한 ablation & 가장 좋은 디자인 선택을 알아낸다.

- self-improve를 위한 서로 다른 두 가지 방식을 연구하였는데, 모델이 한정된 input question으로부터 추가적 question을 생성하는 것과 few-shot CoT prompt 템플릿을 생성하는 것이다.

2. Method

LMSI의 개요는 그림 1에 나타나 있다: pre-trained LLM $M$과 question-only training dataset $D^{train} = \left\{ x_{i} \right\}_{i=1}^{D}$와 few-shot CoT example이 함께 주어진다. 여기에 $D^{train}$에서 각 question $x_{i}$에 대한 $m$ 개의 추론 경로와 answer $\left\{ r_{i1}, r_{i2}, \cdots, r_{im}\right\}$를 생성하기 위해 sampling temperature $T > 0$을 사용한 다중 경로 디코딩을 적용한다. 그리고 가장 일관되고, high-confident 한 응답을 선택하기 위해 majority voting(Self-Consistency)를 사용한다. 그다음에 가장 일관된 대답을 내놓는 추론 경로를 유지시키고 augmentation을 위해 mixed format의 prompt와 answer를 적용하고 이 self-generated 추론-대답 데이터에서 모델을 fine-tune 한다.

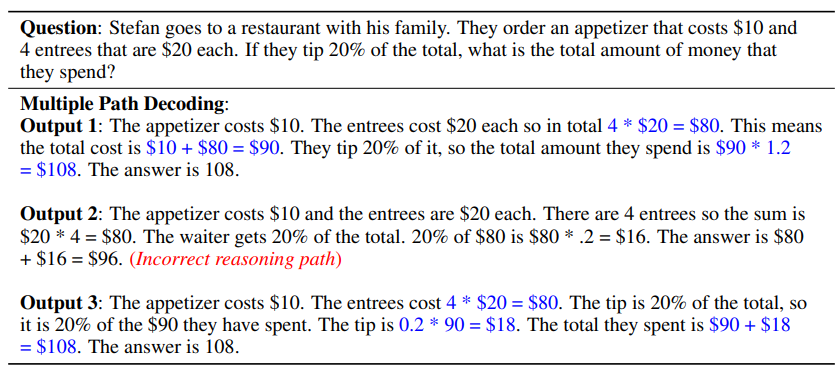

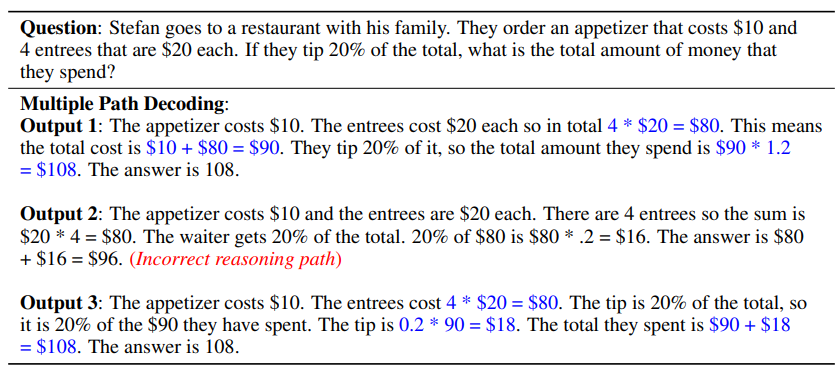

2-1. Generating and Filtering Multiple Reasoning Paths

각 training question $x_{i}$에 대해 $m$ 개의 CoT 추론 경로($\left\{ r_{1i}, r_{2i}, \cdots, r_{im}\right\}$)를 샘플링하는데(표 1), 이들의 예측된 answer $\left\{ y_{i1}, y_{i2}, \cdots, y_{im}\right\}$를 만들기 위해 "The answer is"로 똑같은 output parsing을 적용하였다. 가장 일관된 answer는 majority voting에 의해 선택되고 $\tilde{y}_{i}$가 최종 대답으로 도달하는 CoT 추론 경로를 필터링해서 self-training data에 집어넣는다.

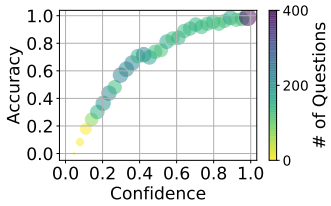

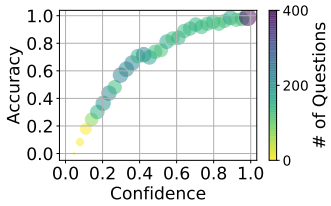

논문에서는 GSM8K training set에서 각 question에 대한 self-generated CoT 경로의 accuracy와 confidence 간의 관계를 그래프로 나타냈다(그림 2). 여기서 confidence는 $\tilde{y}$로 이끄는 CoT 경로의 수/총 경로의 수이다. 그림 2의 y축은 특정 confidence 하에서 $\tilde{y}$의 accuracy이다. 동그라미 영역과 색깔의 진함은 특정 confidence 하에서 question의 수를 보여준다. 논문에서는 confident answer는 correct일 확률이 높다는 것을 관찰하였다. question이 많은 일관된 CoT 경로를 가질 때, 해당하는 $\tilde{y}$는 correct일 확률이 높고, 반대로 $\tilde{y}$가 틀렸을 때 적은 CoT 경로에 의해 지지됐을 확률이 높다.

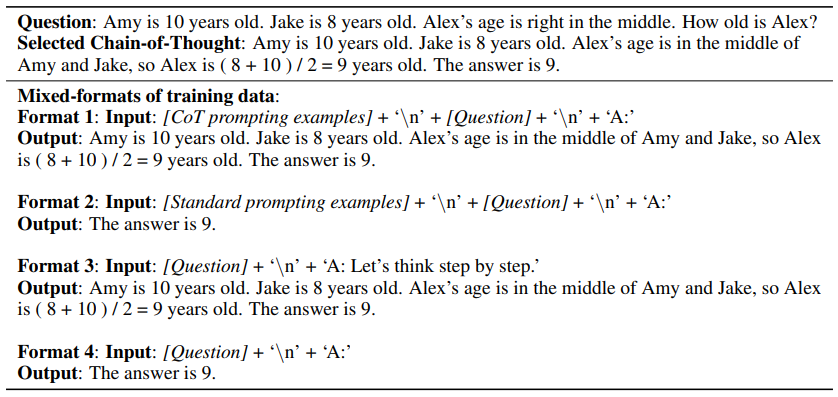

2-2. Training with Mixed Formats

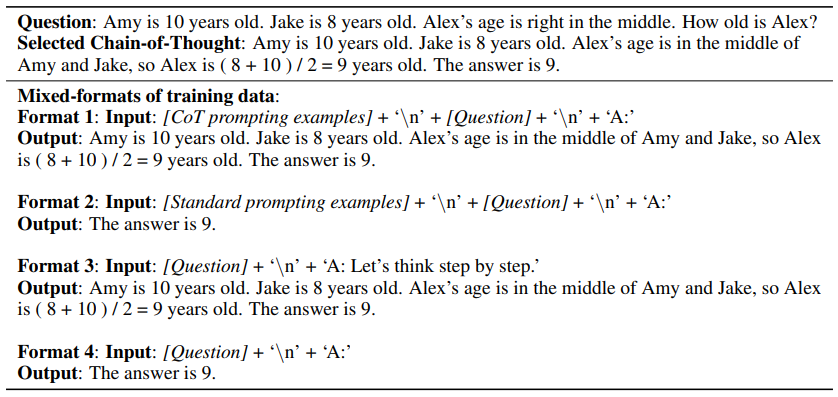

LM이 구체적인 prompt 또는 answer style에 오버피팅되는 것을 방지하기 위해 self-training 데이터에서 혼합할 각 추론 경로에 대해 4가지 형식을 만들었다. 포맷의 종류는 다음과 같다. training sample의 혼합된 포맷은 PLM $M$을 fine-tune 하기 위해 사용된다.

- 소수의 CoT example이 새로운 question 앞에 추가되지만 LM output은 필터링된 CoT 추론 경로와 똑같아지게 학습된다.

- question의 example과 이들의 direct answer를 standard prompting으로 사용한다. 그리고 LM output은 오직 direct answer만 포함하도록 가정된다.

- 1과 유사하지만 question-answer 쌍의 예시가 주어지지 않음. 모델이 CoT 추론을 출력하기를 원함

- 2와 유사하지만 question-answer 쌍의 예시가 주어지지 않음.

2-3. Generating Questions and Prompts

training question 세트 & 소수의 human-written CoT example이 prompt로 주어지면 LMSI는 모델이 self-improve 하도록 하게 해 준다. 하지만 training question 또는 CoT example의 수가 제한되면 충분한 training sample을 만들지 못할 수도 있다. 웹에서 question을 수집하는 것은 human engineering을 필요로 한다. 이러한 사람의 필요를 줄이기 위해 논문에서는 example prompt 뿐만 아니라 더 많은 training question을 어떻게 self-generate 하는지 조사하였다.

Question Generation. 이전의 데이터 augmentation method는 분류 task로 디자인되고 각 few-shot example을 위한 ground-truth 라벨을 필요로 한다. 논문에서는 이에 대한 해결책으로 랜덤 하게 여러 question을 선택하고 이들을 랜덤 순서로 연결해서 input prompt로 만들었다. 그리고 LM이 연속된 시퀀스를 새로운 question으로 만들도록 허락해 준다. 새로운 question의 대규모 세트를 얻기 위해 이 프로세스를 반복한 다음에 highly confident answer를 가지는 question만을 유지하기 위해 Self-Consistency를 사용하였다. 이 question들은 self-generated training question으로 사용된다.

Prompt Generation. question 세트가 주어지면 사람은 CoT example을 최종 대답으로 이끄는 추론 경로를 작성한다. manual prompt가 없는 zero-shot 세팅에서 모델 자신을 사용해 이러한 CoT 경로를 만들 수 있다. Zero-shot-CoT 논문을 따라서 대답은 "A: Let's think step-by-step"으로 시작하고 LM이 연이은 추론 경로를 생성할 수 있도록 허락해 주었다. 그다음에 이렇게 생성된 추론 경로를 few-shot CoT prompting을 위한 추론 경로로 사용하였다.

3. Experimental Setup

Tasks & Datasets. 논문에서는 LMSI의 효과를 3개 유형의 task에서 설명하였다: Arithmetic Reasoning, Commonsense Reasoning, Natural Language Inference.

Models, Training settings and Hyperparameters. 논문의 실험은 Transformer 기반 540B LM에서 진행되었다.

4. Results

4-1. Main Results

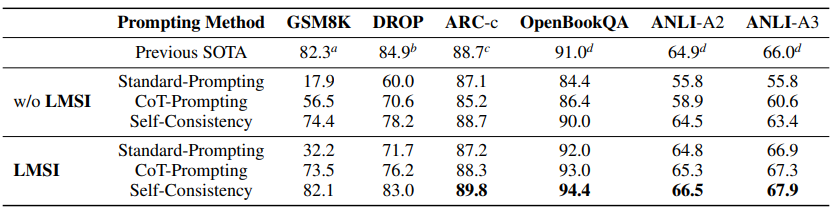

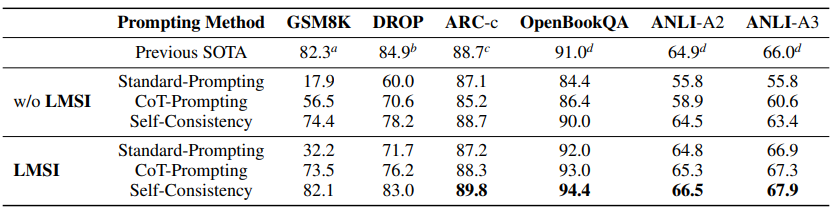

논문에서는 표 3에서 base PaLM-540B 모델의 결과와 LMSI를 적용한 모델의 결과를 보여주고 있다. 각 모델에 대해 test time 중에 6개의 데이터셋에서 3개의 서로 다른 prompting method를 적용하였다: standard-prompting, CoT-prompting, Self-Consistency. 그 결과, LMSI를 적용한 후에 모든 3개의 prompting method의 성능이 큰 값으로 향상되었다. 이것은 논문에서 제안된 method가 꽤 효과적이었다는 것을 보여준다. 게다가, LMSI의 단일 경로 CoT-Prompting 성능은 LMSI가 없는 다중 경로 Self-Consistency의 성능보다 비슷하거나 더 나았다. 이것은 LMSI가 LM이 여러 개의 일관된 추론 경로로부터 학습할 수 있게 도와준다는 것을 보여준다. 또한 LMSI의 결과와 이전 SoTA들의 결과를 표 3에서 비교하였다. 6개의 데이터셋 중 5개의 데이터셋에서 LMSI는 이전의 SoTA들을 능가하는 성능을 보여줬다.

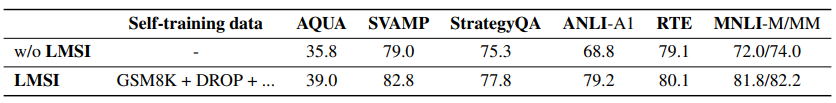

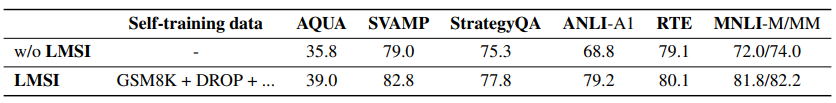

Multi-task self-training from unseen tasks. LMSI의 일반화 능력을 설명하기 위해 위 6개 데이터셋으로부터 training-set question의 혼합에서 self-training의 실험을 수행하였다. 그 다음에 표 4에서 보이는 것처럼 평가를 위해 6개의 Out-Of-Domain(OOD) task에서 똑같은 모델 체크포인트를 사용하였다. 표 4로부터 LMSI는 모든 OOD task에서 더 높은 정확도를 달성하는 것을 관찰할 수 있었다. 이것은 LM의 전반적인 추론 능력이 개선되었다는 것을 보여준다.

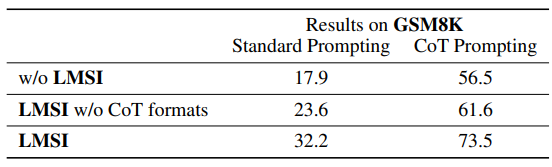

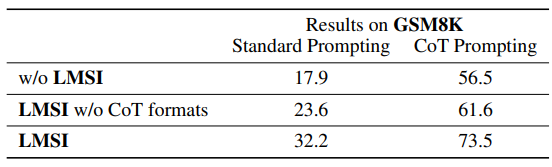

Importance of training with Chain-of-Thought formats. CoT를 사용하여 LM을 학습시키는 것의 중요성을 오직 direct answer를 사용해 학습한 것과 비교하여 설명하였다. 표 5에서 4개의 포맷을 사용한 LMSI의 결과와 오직 direct answer format을 사용한 LMSI의 결과를 보여주고 있다. 결과는 CoT format 없이도 LM이 self-improve 할 수 있다는 것을 보여주지만, 모든 4개의 포맷을 사용하는 것과 비교해서 큰 성능 저하가 일어난다.

4-2. Pushing the Limit of Self-Improvements

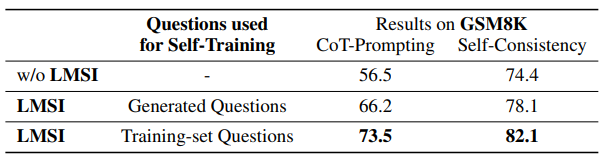

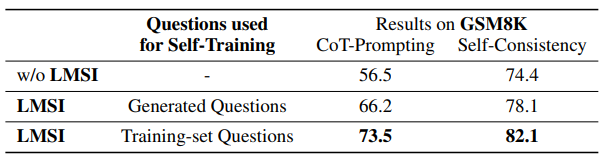

Self-Generating Questions. 논문에서는 추가적으로 타깃 도메인에서 오직 제한된 training question만이 있는 few-shot setting을 추가적으로 탐구하였다. GSM8K에서 10개의 real question을 few-shot 샘플로 샘플링하고 method에서 사용되는 더 많은 training question과 함께 LM을 self-train 시켰다. 그 결과가 표 6에 나타나 있다. self-generated question을 사용해도 추론 능력 개선을 보여줬지만 real training-set question을 사용하면 더 나은 결과를 이끈다.

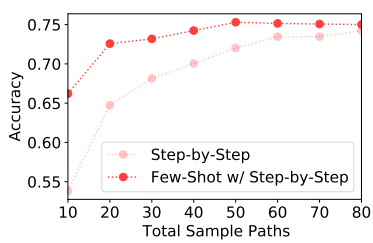

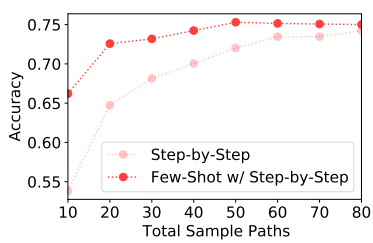

Self-Generating Few-Shot CoT Prompts. 논문에서는 in-domain CoT example이 task에 대해 제공되지 않는 경우를 탐구하였다. 논문에서는 LM을 사용해서 CoT example을 생성하기 위해 Step-by-Step method를 적용하였고, 그 결과가 그림 3에 나타나 있다. self-generated step-by-step CoT example을 사용한 few-shot prompting은 step-by-step baseline을 상당히 능가하고, human-written few-shot CoT의 성능과 거의 맞먹었다. prompt example의 제한된 정확도에도 불구하고 'Few-shot w/ Step-by-Step'의 강력한 성능은 다중 경로 디코딩을 위해 보다 다양한 CoT prompt를 활용하는 데에서 비롯된 것 같다.

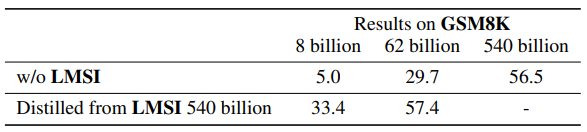

4-3. Distillation to Smaller Models

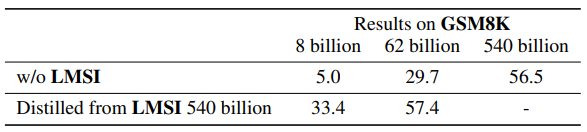

논문에서는 지식이 smaller model로 distill 될 수 있는지에 대해 연구하였다. PaLM-540B에 의해 생성된 똑같은 training 샘플을 사용하지만, smaller size model에서 fine-tune을 하였다. CoT prompting의 결과가 표 7에 보이고 있다. 결과를 살펴보면 LMSI로부터 distill 후에 smaller model은 larger model을 능가하는 모습을 보여줬다.

출처

https://arxiv.org/abs/2210.11610

Large Language Models Can Self-Improve

Large Language Models (LLMs) have achieved excellent performances in various tasks. However, fine-tuning an LLM requires extensive supervision. Human, on the other hand, may improve their reasoning abilities by self-thinking without external inputs. In thi

arxiv.org

'Paper Reading 📜 > Natural Language Processing' 카테고리의 다른 글

The overview of this paper

LLM은 fine-tune 하는데 광범위한 supervision을 필요로 하는 반면에 사람은 외부적 입력 없이 self-thinking을 함으로써 추론 능력을 향상시킬 수 있다. 이 논문에서는 LLM도 오직 unlabeled dataset만을 사용하여 self-improve 할 수 있다는 것을 설명한다. 논문에서는 CoT prompting과 Self-Consistency를 사용해서 unlabeled question에 대한 'high-confidence' ratinoale-augmented answer를 생성하기 위해 PLM을 사용하고 이 self-generated solution을 이 self-generated solution을 타깃 output으로 해서 LLM을 fine-tune 한다. 논문의 실험에서는 어떠한 ground-truth 라벨 없이 540B-parameter LLM의 추론 능력을 향상시켜서 SoTA를 달성했다.

Table of Contents

1. Introduction

2. Method

3. Experimental Setup

4. Results

1. Introduction

대규모 텍스트 corpus에서 학습된 모델의 놀라운 능력에도 불구하고, 근본적으로 few-shot baseline 모델의 성능을 향상시키는 것은 아직 광범위한 양의 high-qulaity supervised 데이터셋에서의 fine-tuning을 필요로 한다. 이 high-quality 데이터를 수집하기 위한 상당한 노력이 있었던 반면에, 메타인지 프로세스에서는 high-quality 데이터를 많이 수집해서 외부 입력 없이 스스로 추론 능력을 개선할 수 있다.

이 논문에서는 LLM이 어떻게 supervised data 없이 이들의 추론 능력을 self-improve 할 수 있었던 것인지에 대해 연구하였다. 논문에서는 오직 다양한 NLP task 데이터셋으로부터의 입력 시퀀스만을 사용해서 PLM이 in-domain & out-of-domain task 모두에 대해 성능을 향상시킬 수 있다는 것을 보여주었다. 논문에 사용된 method는 그림 1에 나타나 있고, 그 과정은 다음과 같다.

- few-shot CoT를 prompt로 사용해서 다양한 예측을 샘플링함

- high-confidence 예측을 majority voting(Self-Consistency)를 사용해서 필터링

- 이 high-confidence 예측에서 LLM을 fine-tune함

결과로 나온 모델은 greedy & multi-path 평가 모두에서 개선된 추론을 보여준다. 논문에서는 이런 방식으로 fine-tune 된 모델을 Language Model Self-Improved(LMSI)라고 이름 붙였다. 이 방식은 사람의 뇌가 학습하는 방법과 유사하다.

논문의 contribution은 다음과 같다:

- LLM은 ground-truth output 없이 CoT 추론을 활용함으로써 self-improve 할 수 있다. 또한 유망한 in-domain multi-task 성능뿐만 아니라 out-of-domain 일반화도 달성할 수 있다는 것을 설명한다.

- training 포맷팅과 샘플링 포맷팅에 대한 ablation & 가장 좋은 디자인 선택을 알아낸다.

- self-improve를 위한 서로 다른 두 가지 방식을 연구하였는데, 모델이 한정된 input question으로부터 추가적 question을 생성하는 것과 few-shot CoT prompt 템플릿을 생성하는 것이다.

2. Method

LMSI의 개요는 그림 1에 나타나 있다: pre-trained LLM $M$과 question-only training dataset $D^{train} = \left\{ x_{i} \right\}_{i=1}^{D}$와 few-shot CoT example이 함께 주어진다. 여기에 $D^{train}$에서 각 question $x_{i}$에 대한 $m$ 개의 추론 경로와 answer $\left\{ r_{i1}, r_{i2}, \cdots, r_{im}\right\}$를 생성하기 위해 sampling temperature $T > 0$을 사용한 다중 경로 디코딩을 적용한다. 그리고 가장 일관되고, high-confident 한 응답을 선택하기 위해 majority voting(Self-Consistency)를 사용한다. 그다음에 가장 일관된 대답을 내놓는 추론 경로를 유지시키고 augmentation을 위해 mixed format의 prompt와 answer를 적용하고 이 self-generated 추론-대답 데이터에서 모델을 fine-tune 한다.

2-1. Generating and Filtering Multiple Reasoning Paths

각 training question $x_{i}$에 대해 $m$ 개의 CoT 추론 경로($\left\{ r_{1i}, r_{2i}, \cdots, r_{im}\right\}$)를 샘플링하는데(표 1), 이들의 예측된 answer $\left\{ y_{i1}, y_{i2}, \cdots, y_{im}\right\}$를 만들기 위해 "The answer is"로 똑같은 output parsing을 적용하였다. 가장 일관된 answer는 majority voting에 의해 선택되고 $\tilde{y}_{i}$가 최종 대답으로 도달하는 CoT 추론 경로를 필터링해서 self-training data에 집어넣는다.

논문에서는 GSM8K training set에서 각 question에 대한 self-generated CoT 경로의 accuracy와 confidence 간의 관계를 그래프로 나타냈다(그림 2). 여기서 confidence는 $\tilde{y}$로 이끄는 CoT 경로의 수/총 경로의 수이다. 그림 2의 y축은 특정 confidence 하에서 $\tilde{y}$의 accuracy이다. 동그라미 영역과 색깔의 진함은 특정 confidence 하에서 question의 수를 보여준다. 논문에서는 confident answer는 correct일 확률이 높다는 것을 관찰하였다. question이 많은 일관된 CoT 경로를 가질 때, 해당하는 $\tilde{y}$는 correct일 확률이 높고, 반대로 $\tilde{y}$가 틀렸을 때 적은 CoT 경로에 의해 지지됐을 확률이 높다.

2-2. Training with Mixed Formats

LM이 구체적인 prompt 또는 answer style에 오버피팅되는 것을 방지하기 위해 self-training 데이터에서 혼합할 각 추론 경로에 대해 4가지 형식을 만들었다. 포맷의 종류는 다음과 같다. training sample의 혼합된 포맷은 PLM $M$을 fine-tune 하기 위해 사용된다.

- 소수의 CoT example이 새로운 question 앞에 추가되지만 LM output은 필터링된 CoT 추론 경로와 똑같아지게 학습된다.

- question의 example과 이들의 direct answer를 standard prompting으로 사용한다. 그리고 LM output은 오직 direct answer만 포함하도록 가정된다.

- 1과 유사하지만 question-answer 쌍의 예시가 주어지지 않음. 모델이 CoT 추론을 출력하기를 원함

- 2와 유사하지만 question-answer 쌍의 예시가 주어지지 않음.

2-3. Generating Questions and Prompts

training question 세트 & 소수의 human-written CoT example이 prompt로 주어지면 LMSI는 모델이 self-improve 하도록 하게 해 준다. 하지만 training question 또는 CoT example의 수가 제한되면 충분한 training sample을 만들지 못할 수도 있다. 웹에서 question을 수집하는 것은 human engineering을 필요로 한다. 이러한 사람의 필요를 줄이기 위해 논문에서는 example prompt 뿐만 아니라 더 많은 training question을 어떻게 self-generate 하는지 조사하였다.

Question Generation. 이전의 데이터 augmentation method는 분류 task로 디자인되고 각 few-shot example을 위한 ground-truth 라벨을 필요로 한다. 논문에서는 이에 대한 해결책으로 랜덤 하게 여러 question을 선택하고 이들을 랜덤 순서로 연결해서 input prompt로 만들었다. 그리고 LM이 연속된 시퀀스를 새로운 question으로 만들도록 허락해 준다. 새로운 question의 대규모 세트를 얻기 위해 이 프로세스를 반복한 다음에 highly confident answer를 가지는 question만을 유지하기 위해 Self-Consistency를 사용하였다. 이 question들은 self-generated training question으로 사용된다.

Prompt Generation. question 세트가 주어지면 사람은 CoT example을 최종 대답으로 이끄는 추론 경로를 작성한다. manual prompt가 없는 zero-shot 세팅에서 모델 자신을 사용해 이러한 CoT 경로를 만들 수 있다. Zero-shot-CoT 논문을 따라서 대답은 "A: Let's think step-by-step"으로 시작하고 LM이 연이은 추론 경로를 생성할 수 있도록 허락해 주었다. 그다음에 이렇게 생성된 추론 경로를 few-shot CoT prompting을 위한 추론 경로로 사용하였다.

3. Experimental Setup

Tasks & Datasets. 논문에서는 LMSI의 효과를 3개 유형의 task에서 설명하였다: Arithmetic Reasoning, Commonsense Reasoning, Natural Language Inference.

Models, Training settings and Hyperparameters. 논문의 실험은 Transformer 기반 540B LM에서 진행되었다.

4. Results

4-1. Main Results

논문에서는 표 3에서 base PaLM-540B 모델의 결과와 LMSI를 적용한 모델의 결과를 보여주고 있다. 각 모델에 대해 test time 중에 6개의 데이터셋에서 3개의 서로 다른 prompting method를 적용하였다: standard-prompting, CoT-prompting, Self-Consistency. 그 결과, LMSI를 적용한 후에 모든 3개의 prompting method의 성능이 큰 값으로 향상되었다. 이것은 논문에서 제안된 method가 꽤 효과적이었다는 것을 보여준다. 게다가, LMSI의 단일 경로 CoT-Prompting 성능은 LMSI가 없는 다중 경로 Self-Consistency의 성능보다 비슷하거나 더 나았다. 이것은 LMSI가 LM이 여러 개의 일관된 추론 경로로부터 학습할 수 있게 도와준다는 것을 보여준다. 또한 LMSI의 결과와 이전 SoTA들의 결과를 표 3에서 비교하였다. 6개의 데이터셋 중 5개의 데이터셋에서 LMSI는 이전의 SoTA들을 능가하는 성능을 보여줬다.

Multi-task self-training from unseen tasks. LMSI의 일반화 능력을 설명하기 위해 위 6개 데이터셋으로부터 training-set question의 혼합에서 self-training의 실험을 수행하였다. 그 다음에 표 4에서 보이는 것처럼 평가를 위해 6개의 Out-Of-Domain(OOD) task에서 똑같은 모델 체크포인트를 사용하였다. 표 4로부터 LMSI는 모든 OOD task에서 더 높은 정확도를 달성하는 것을 관찰할 수 있었다. 이것은 LM의 전반적인 추론 능력이 개선되었다는 것을 보여준다.

Importance of training with Chain-of-Thought formats. CoT를 사용하여 LM을 학습시키는 것의 중요성을 오직 direct answer를 사용해 학습한 것과 비교하여 설명하였다. 표 5에서 4개의 포맷을 사용한 LMSI의 결과와 오직 direct answer format을 사용한 LMSI의 결과를 보여주고 있다. 결과는 CoT format 없이도 LM이 self-improve 할 수 있다는 것을 보여주지만, 모든 4개의 포맷을 사용하는 것과 비교해서 큰 성능 저하가 일어난다.

4-2. Pushing the Limit of Self-Improvements

Self-Generating Questions. 논문에서는 추가적으로 타깃 도메인에서 오직 제한된 training question만이 있는 few-shot setting을 추가적으로 탐구하였다. GSM8K에서 10개의 real question을 few-shot 샘플로 샘플링하고 method에서 사용되는 더 많은 training question과 함께 LM을 self-train 시켰다. 그 결과가 표 6에 나타나 있다. self-generated question을 사용해도 추론 능력 개선을 보여줬지만 real training-set question을 사용하면 더 나은 결과를 이끈다.

Self-Generating Few-Shot CoT Prompts. 논문에서는 in-domain CoT example이 task에 대해 제공되지 않는 경우를 탐구하였다. 논문에서는 LM을 사용해서 CoT example을 생성하기 위해 Step-by-Step method를 적용하였고, 그 결과가 그림 3에 나타나 있다. self-generated step-by-step CoT example을 사용한 few-shot prompting은 step-by-step baseline을 상당히 능가하고, human-written few-shot CoT의 성능과 거의 맞먹었다. prompt example의 제한된 정확도에도 불구하고 'Few-shot w/ Step-by-Step'의 강력한 성능은 다중 경로 디코딩을 위해 보다 다양한 CoT prompt를 활용하는 데에서 비롯된 것 같다.

4-3. Distillation to Smaller Models

논문에서는 지식이 smaller model로 distill 될 수 있는지에 대해 연구하였다. PaLM-540B에 의해 생성된 똑같은 training 샘플을 사용하지만, smaller size model에서 fine-tune을 하였다. CoT prompting의 결과가 표 7에 보이고 있다. 결과를 살펴보면 LMSI로부터 distill 후에 smaller model은 larger model을 능가하는 모습을 보여줬다.

출처

https://arxiv.org/abs/2210.11610

Large Language Models Can Self-Improve

Large Language Models (LLMs) have achieved excellent performances in various tasks. However, fine-tuning an LLM requires extensive supervision. Human, on the other hand, may improve their reasoning abilities by self-thinking without external inputs. In thi

arxiv.org