The overview of this paper

LM을 instruction으로 표현되어 있는 데이터셋 모음에서 fine-tune하는 것은 향상된 성능과 unseen task에 대한 일반화를 보여주고 있다. 이 논문에서는 instruction fine-tuning을 특별한 관점에서 들여다 보았다.

- task의 수 늘리기

- 모델 사이즈 늘리기

- CoT 데이터에서 fine-tune

위의 측면을 사용한 instruction fine-tuning은 성능을 상당히 향상시키는 모습을 보여젔다. 전반적으로 instruction fine-tuning은 성능과 pre-trained LM의 가용성을 향상시키기 위한 일반적인 방법이다.

Table of Contents

1. Introduction

2. Flan Finetuning

3. Scaling to 540B parameters and 1.8K tasks

4. Finetuning with chain-of-thought annotations

5. Putting it all together

6. Usability evaluation of open-ended generation

7. Discussion

1. Introduction

이 논문에서는 instruction fine-tuning을 여러가지 방법으로 발전시켰다.

- instruction fine-tuning에서의 scaling 효과를 연구 → task의 수 & 모델의 사이즈와 함께 잘 scale 되었음.

- 추론 task를 수행하기 이한 모델의 능력에서 fine-tuning의 효과를 연구 → 9개의 CoT 데이터셋을 추가 학습 만으로도 모든 평가에서 나은 성능을 보여줌

이러한 발견에 기반하여 540B 파라미터 모델을 사용해, fine-tuning task의 수를 1.8K로 늘리고, CoT 데이터를 포함함으로써 Flan-PaLM을 학습시켰다. Flan-PaLM은 기존의 PaLM을 능가하는 성능을 보여줬고, 몇몇 task에서는 SoTA를 달성하기도 했다. human rater들의 평가에 의하면, Flan-PaLM은 어려운 open-ended 생성 질문에서 PaLM을 능가하고, 개선된 가용성을 보여줬다. 게다가, 논문에서는 instruction fine-tuning이 여러 AI 평가 벤치마크에 대해 성능을 향상시킨다는 것을 발견하였다.

또한 논문에서는 Flan-T5 모델(80M to 11B)을 instruction fine-tune 하였다. 이러한 checkpoint는 zero-shot, few-shot, CoT 능력을 가지고 있고, 이전의 공공 checkpoint인 T5를 능가하는 모습을 보여줬다. 전반적으로 논문의 실험 결과는 어떻게 instruction fine-tuning이 다양한 모델, prompt setup, 평가 task에 대해 성능을 향상시킬 수 있는지 보여주고 있다.

2. Flan Finetuning

다양한 instruction 템플릿을 사용한 데이터 모음에서 instruction fine-tune을 하였다. 그리고 이 fine-tuning 프로시저를 'Flan'이라 하고, 이 fine-tuning 프로시저를 사용한 모델의 이름 앞에는 'Flan'을 추가하였다.

2-1. Finetuning Data

Task mixtures. 논문에서는 이전 연구들에서 사용된 4개의 mixture(Muffin, T0-SF, NIV2, CoT)를 묶어서 1,836개의 finetuning task로 scale up 하였다. 이 데이터셋이 다음의 그림 2에 요약되어 있다.

Chain-of-thought finetuning mixture. 네 번째 데이터 mixture(reasoning)은 CoT annotation에서 fine-tune 하는 것이 unseen 추론 task에서 성능을 향상시키는지 관찰하기 위해 사용되는 CoT를 포함하고 있다. 논문에서는 human rater가 직접 training corpus에 대한 CoT annotation을 작성한 9개의 데이터셋을 생성하였다. 이 9개의 데이터셋은 task 당 10개의 instruction으록 구성되어 있다.

Templates and formatting. Muffin, T0-SF, NIV2에 대해서 논문에서는 instruction 형식의 템플릿을 사용하였다. CoT에 대해서는 각 데이터셋 당 10개의 instruction을 직접 작성하였다. few-shot 템플릿을 만들기 위해서, 논문에서는 다양한 구분자(ex. Q: / A:)을 작성하고 example 레벨에 랜덤하게 적용하였다. CoT가 있거나 없는 경우와 예제가 있는 경우와 없는 경우 모두에 대한 formatting의 예가 그림 3에 나타나 있다.

2-2. Finetuning procedure

논문에서는 instruction fine-tuning을 여러 모델들에 대해 적용하였다. 각각의 모델에 대해 똑같은 training 프로시저를 적용하였다. 논문에서 추가적으로 사용한 method들은 다음과 같다.

- packing: 다양한 training 예시를 하나의 시퀀스로 묶음

- End-of-Sequence token: 타깃으로부터 입력을 분리

- masking: 다른 packed 예시를 참조하지 못하도록 사용

각각의 모델에 대해 논문에서는 모든 평가에 대해 가장 최적의 checkpoint를 사용하였다. 특히, fine-tuning에 사용되는 계산량은 training하는데 사용되는 계산량의 극소에 불과하다. 이것이 표 2에 나타나 있다.

2-3. Evaluation protocol

Evaluation benchmarks. 논문에서는 fine-tuning 데이터에 포함되어 있지 않은 held-out task에서의 성능에 집중하였다. 그리고 특히 Flan-PaLM의 세계정세의 지식과 추론 task에 대한 전반적인 능력에 흥미를 느꼈다. 논문에서는 모델을 fine-tuning mixture에 포함되어 있는 데이터가 아닌 다양한 벤치마크에서 평가를 하였다. 논문에서 사용한 벤치마크는 다음과 같다.

- MMLU: 수학, 역사, 법, 의학과 같은 57개 task의 시험 질문을 포함

- BBH: PaLM이 평균 human rater보다 낮은 성능을 보여주는 BIG-Bench의 23개의 어려운 task 포함

- TyDiQA: 8개의 다양한 언어에 대한 question-answering 벤치마크

- MGSM: 수학 단어 문제의 multilingual 벤치마크

Evaluation methods and metrics. MMLU와 BBH에 대해, 논문에서는 direct prompting을 통한 answer를 직접적으로 예측하는 능력을 평가하고, 뿐만 아니라 CoT prompting을 통한 평가도 진행하였다. CoT prompting에서 모델은 최종 대답을 내놓기 전에 추론 체인을 제공해야만 한다. 모든 벤치마크에 대해서 논문에서는 이전 연구를 따라서 주어진 few-shot exemplar를 사용하였다: five-shot MMLU, three-shot BBH, one-shot TyDiQA, 8-shot MGSM. 주어진 모델에 대해 하나의 정규화된 평균 metric을 기록하였다.

3. Scaling to 540B parameters and 1.8K tasks

논문에서는 처음에 모델의 사이즈 & fine-tuning task의 수 에서 오는 효과를 파악하였다. 그러기 위해 PaLM 모델의 사이즈를 달리함으로써 모델 사이즈를 scale 하고, task의 수를 scale하기 위해 적은 수의 task를 가지는 mixture부터 많은 수의 task를 가지는 mixture 순으로 순차적으로 task mixture을 추가하였다: CoT, Muffin, T0-SF, NIV2.

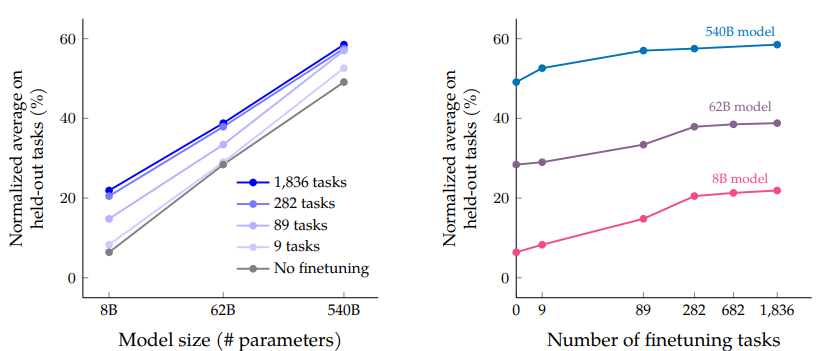

그림 4는 held-out 벤치마크의 정규화된 평균에서 이 두 변수의 scaling의 공동 효과를 보여주고 있다. 각각의 벤치마크에서의 결과는 표 3에 나타나 있다. 결과를 살펴보면 다음과 같다.

- 3개 사이즈의 모델 모두에서 multi-task instruction fine-tuning은 no fine-tuning과 비교하여 큰 마진으로 성능을 향상시켰다.

- fine-tuning task의 수를 늘리는 것이 성능을 향상시킨다. 비록 대부분의 성능 향상은 최대 282개의 task를 사용할 때 까지만 발생하지만 말이다. 이는 모델 학습으로부터 오는 multi-task instruction fine-tuning의 대부분의 성능 향상은 pre-training으로부터 이미 알게 된 지식을 더 잘 표현하기 위해서이기 때문이다. 그리고 이때 282개 보다 더 많은 수의 task는 별로 도움이 되지 않는다. 이 설명이 말이 되는 이유는 pre-training 데이터는 780B 개의 토큰으로 이루어져 있는 반면에, instruction fine-tuning은 오직 1.4B개의 토큰만을 사용하기 때문이다.

- 모델의 사이즈를 늘리는 것은 finetuned & non-finetuned 모델 둘 다 성능을 상당히 향상시킨다. 그래서 instruction fine-tuning이 small model 또는 large model 중에 무엇을 더 개선시키는지 판단하는 것은 복잡하다. 예를 들어 540B 모델에 비해 8B 모델의 성능 향상은 더 크지만, error rate 감소는 540B 모델이 더 크다.

이러한 scaling curve를 그려보면 어떻게 모델의 사이즈를 늘리고 task의 수를 늘려야 성능을 개선시킬 수 있는지 파악이 가능하다. 모델 사이즈를 다른 크기로 확장하면 상당한 성능 향상을 제공할 것이다. fine-tuning task의 수를 조정하면 점진적이긴 하지만, 성능 또한 향상될 것이다. 전반적으로, scaling curve는 향후 연구에서도 instruction finetuning의 scaling을 계속해야 한다는 것을 보여준다.

4. Finetuning with chain-of-thought annotations

Flan fine-tuning의 목표는 전통적인 NLP task에 multi-step 추론 능력을 포함하는 다양한 평가에 대해 개선된 checkpoint를 생성하는 것이다. 이 섹션에서는 instruction fine-tuning mixture에서 CoT를 포함하는 것의 효과를 연구하였다. 그 결과는 다음과 같다.

- Flan-PaLM의 개선된 추론 능력은 여러 벤치마크에서 이전 모델들을 능가하였다.

- 그 다음에 CoT fine-tuning 데이터에 ablation을 진행하였고, CoT를 포함하지 않는 instruction fine-tuning은 추론 능력을 약화시켰고, 9개의 CoT 데이터셋을 포함하는 것만으로 모든 평가에서 개선된 성능을 보여줬다.

- CoT fine-tuning은 어려운 BIG-Bench task에서 'let's think step by step'을 통해 zero-shot 추론을 가능하게 하였다.

4-1. Finetuning on chain-of-thought improves reasoning on held-out tasks

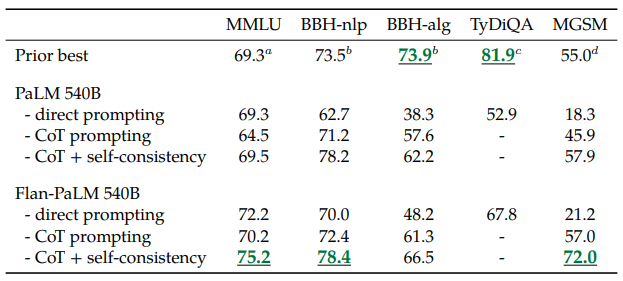

CoT annotation이 있는 9개의 데이터셋을 fine-tuning mixture에 포함시키는 것만으로도 추론 능력은 향상된다. 표 4는 Flan-PaLM의 CoT prompting 능력이 PaLM을 능가하는 것을 보여준다.

표 4는 또한 어떻게 CoT prompting이 self-consistency와 묶여서 여러 벤치마크에서 SoTA를 달성할 수 있었는지를 보여준다. 예를 들어 MMLU 벤치마크에서 Flan-PaLM은 다른 모델들에 비해 큰 마진으로 더 좋은 성능을 보여준다. MGSM 벤치마크에서 Flan-PaLM with CoT+SC는 SoTA를 상당히 개선시켰을 뿐만 아니라 적게 나타났던 언어에 대해서도 좋은 성능을 보여줬다. 이와 비교해서 PaLM with CoT+SC는 많은 리소스가 있는 언어에 대해서도 떨어지는 성능을 보여줬다. 결과적으로 Flan-PaLM with CoT+SC는 GSM8K에서 새로운 SoTA를 달성하였다. 하지만 Flan-PaLM도 전문화된 모델과 비교해서는 SoTA를 달성하지 못했다.

4-2. Some chain-of-thought data is needed to maintain reasoning ability

instruction fine-tuning에 9개의 CoT 데이터셋을 추가하는 것의 효과에 대해 ablation study를 진행하였다. 논문에서는 held-out CoT 벤치마크(MMLU, BBH, MGSM)과 held-out non-CoT 벤치마크(MMLU, BBH, TyDiQA)를 계층화하고, CoT와 non-CoT에 대한 정규화된 평균을 계산하였다. 그림 5의 왼쪽에서 보이듯이 held-out CoT 벤치마크에서의 성능은 non-CoT+CoT fine-tuning이 just CoT fine-tuning보다 강력하다. 그림 5의 오른쪽은 CoT+CoT fine-tuning은 non-CoT task에서의 성능을 약화시키지 않는다는 것을 입증하였다.

그림 5의 왼쪽의 중요한 포인트는 추론 능력을 유지하기 위해 몇몇 CoT example에서 fine-tune하는 것은 중요하다는 것을 보여준다. 왜냐하면 오직 non-CoT 에서의 fine-tuning은 성능을 하락시키기 때문이다. 이를 그림 5의 초록색 선이 보여준다. 이 모든 걸 종합해서 ablation의 결과를 다음과 같이 해석할 수 있다.

- instruction fine-tuning은 unseen task가 fine-tuning task 처럼 똑같은 prompting 패러다임에 있을 때 unseen task를 향상시킨다. 그래서 모든 평가에서 모델의 능력을 향상시키기 위해서는 non-CoT & CoT 데이터가 필요하다.

4-3. Unlocking zero-shot reasoning

exemplar가 있고 없는 CoT 데이터에서의 instruction fine-tuning의 마지막 이점은 zero-shot 세팅에서 CoT 추론이 수행 가능해진다는 것이다. 이러한 zero-shot 세팅은 중요한데 왜냐하면 CoT에 대한 few-shot exemplar 없이 이들 만의 추론 스킬을 생성하기 위한 모델의 능력을 평가하기 위해서이다.

그림 6은 23개의 unseen BIG-Bench task의 BBH 벤치마크에 대해서 보여준다. 여기서 Flan-PaLM은 "let's think step by step"이라는 구문의 CoT 추론을 활용함으로써 BBH 벤치마크에서 개선된 성능을 달성하였다. 이와 비교하여 fine-tuning을 하지 않은 PaLM은 이러한 문제를 해결하는데 필요한 CoT를 생성하지 않는다. 그림 7에 PaLM과 Flan-PaLM에 대한 zero-shot CoT의 3가지 예시가 나타나있다.

5. Putting it all together

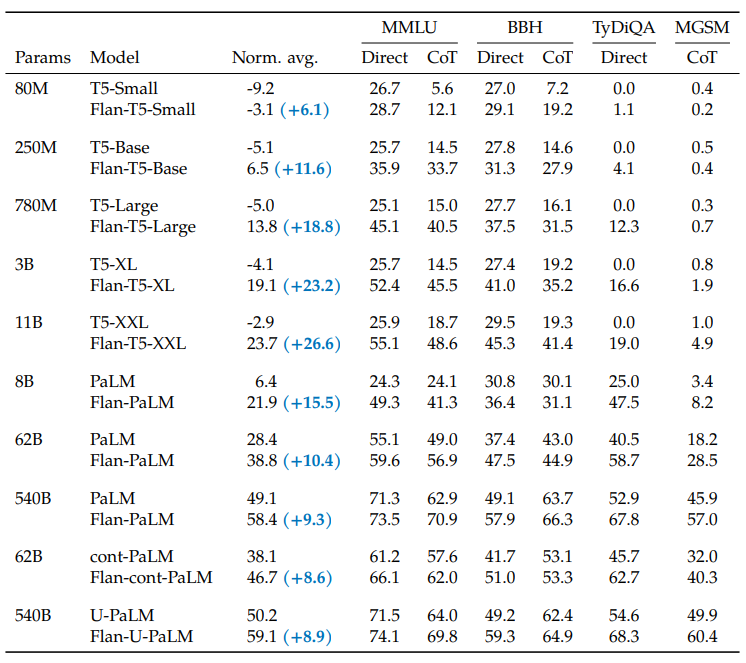

task의 수와 CoT 데이터를 포함함으로써의 결과를 보고 여러 사이즈의 모델, architecture, training objective를 적용함으로써 instruction fine-tuning의 일반성을 보여줬다. 연구에 사용된 모델들은 다음과 같다.

- encoder-decoder T5: PaLM 모델의 family model. 이 모델은 PaLM의 decoder-only architecture과는 대조적.

- cont-PaLM: PaLM 62B 모델의 연장으로 PaLM-62B를 500B가 넘는 토큰에서 학습시켰음.

- U-PaLM: PaLM-540B로 초기화되고 UL2 objective로 pre-train 되었음.

이러한 평가 결과는 표 5에 나타나있다. instruction fine-tuning은 모든 모델 유형에 대해 큰 마진으로 정규화된 평균 성능을 향상시켰다. 평가 벤치마크의 어려움과 T5가 multi-lingual 이라는 사실이 주어지면서 T5 모델은 다른 모델들의 non-fineteuned 모델과 비교하여 instruction fine-tuning으로부터 가장 많은 이득을 얻었다. 결과에서 확인할 수 있었던 전반적으로 가장 강력한 모델은 U-PaLM 모델에서 사용된 instruction fine-tuning과 UL2를 묶어서 진행한 pre-training이다. 이 결과는 instruction fine-tuning과 UL2로 pre-training을 계속하는 것이 모델의 크기를 키우지 않고 LM의 성능을 향상시킬 수 있는 계산 효율적인 방법이라는 것을 보여준다.

6. Usability evaluation of open-ended generation

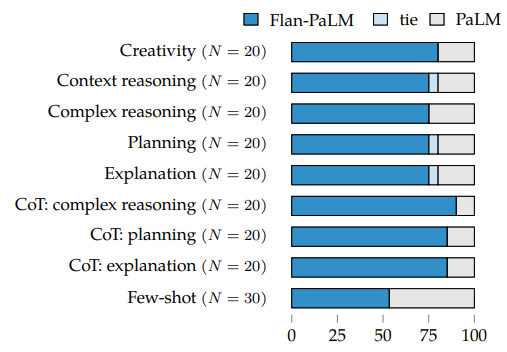

긴 형식의 대답을 평가하기 위해 사용되는 기존의 NLP 벤치마크와 자동 metric은 이러한 자유 형식 응답에 대한 사람의 선호도를 측정하기에 불충분하다. 그래서 논문에서는 어려운 입력에 대한 open-ended 응답을 제공하는 모델의 능력에 대한 instruction fine-tuning의 효과를 조사하는 수동적인 평가를 수행하였다. 이를 위해 논문에서는 190개 예시의 평가 세트를 생성하였다. 이 평가 세트에는 각각 20개의 질문으로 구성된 5개의 어려운 범주에 걸쳐 모델에 zero-shot 방식으로 제기된 질문이 포함된다: 창의성, 문맥에 대한 추론, 복잡한 추론, 계획, 설명. 이러한 예 중 60개에 대해, 논문에서는 CoT trigger 구문(ex. "let's think step-by-step")을 사용한 변형을 생성하였다. 위의 160개의 zero-shot 입력 외에도 instruction fine-tuning이 없는 강력한 LM이 잘 수행하는 것으로 표시된 few-shot 기능을 테스트하는 30개의 입력이 포함되어 있다.

이 평가에서는 PaLM 540B와 Flan-PaLM 540B 모델을 비교하였다. 두 모델이 생성해낸 응답에서 중간값 미만의 값을 제거하고 남는 것 중에서 best score를 갖는 응답을 선택하였다. 중간값 이하의 응답을 제거함으로써 목적과는 다른 응답들을 제거할 수 있었다. 그 다음에 human rater들에게 PaLM과 Flan-PaLM의 출력을 보여주고 기호에 기반하여 응답을 선택하도록 하였다.

사람들의 평가 결과는 다음의 그림 8에 나타나 있다. 190개의 예시 중에서 Flan-PaLM은 79%의 경우에 더욱 선호되었다. 모든 zero-shot 세팅에 대해 Flan-PaLM은 큰 마진으로 선호되었고, CoT trigger 구문을 사용하는 입력에 대한 rater들의 Flan-PaLM에 대한 선호는 10% 정도 더 향상되었다. few-shot에 대해서도 PaLM과 비교하여 퇴보는 없었다.

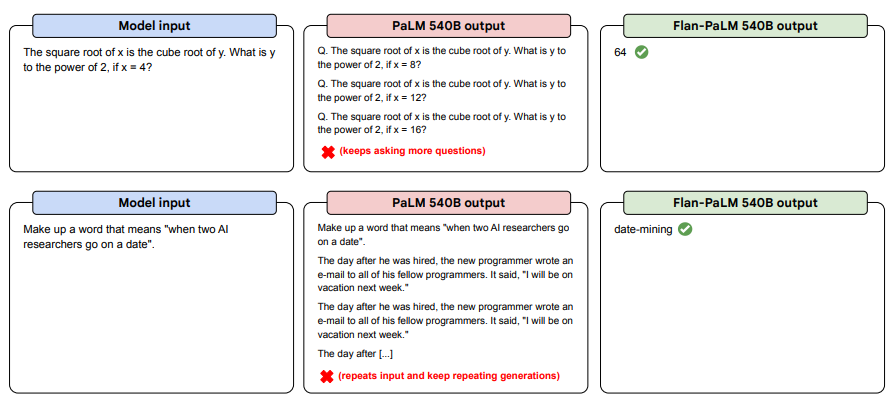

PaLM에 대한 모델 생성을 조사한 결과 NLP 벤치마크의 강력한 성능에도 불구하고 NSP objective에 대한 pre-training만으로는 좋은 zero-shot 사용성에 충분하지 않은 것으로 나타났다. 예를 들어 PaLM이 만들어낸 의도치 않는 특성에 대한 검사는 다음과 같다.

- 질문에 답하기 보다는 연관된 텍스트를 계속 생성해낸다.

- 입력 질문을 살짝씩 수정해서 반복한다.

- 언제 텍스트 생성을 멈춰야하는 지를 모른다.

이 모든 것은 End-of-Sequence(EoS) token을 사용하지 않는 것의 전유물이다. 이렇게 생겨난 오류의 몇 가지 예시가 그림 9에 나타나 있다.

7. Discussion

이 논문에서는 instruction tuning을 다음을 통해서 연장하였다. 결과로 나온 instruction-finetuned 모델은 few-shot, zero-shot, CoT 평가에서 개선된 성능을 보여줬다. 이것을 토대로 이 논문의 결과를 요약하면 다음과 같다.

- fine-tuning task의 수를 늘림

- 모델의 사이즈를 늘림

- CoT 데이터에서 fine-tune

instruction fine-tuning에 대한 scaling curve. 논문에서는 instruction fine-tuning의 2가지 중요 요소를 파악하였다: 모델의 사이즈 & fine-tuning task의 수. 이 두 요소에 대한 scaling curve를 그려봄으로써 모델 사이즈 & fine-tuning task의 수 둘 다를 늘리는 것이 계속적으로 성능을 향상시킨다는 것을 보여줬다. 게다가 non instruction finetuning 모델과 instruction finetuning 모델의 마진은 줄어들지 않았다. 이는 향후 연구에도 instruction fine-tuning을 사용하는 것이 의미있을 것이라는 것을 보여준다.

CoT fine-tuning은 추론 능력에 중요함. 비록 이전의 instruction fine-tuning 연구들에서 non-CoT task에서 fine-tune하는 것이 unseen non-CoT task에 대해서 성능을 향상시킨다는 것을 보여줬지만, 논문에서는 이것이 실제로는 non-CoT task에서 fine-tune한 모델은 CoT task에서 떨어지는 성능을 이끈다는 것을 찾아냈다. 이렇게 저하된 CoT 성능에 대한 해결책으로 non-CoT 데이터와 CoT 데이터 모두에서 공동으로 fine-tune 하였다. joint fine-tuning은 non-CoT task에서의 성능은 유지하고 CoT 성능은 상당히 나아지게 만드는 것을 가능하게 하였다.

instruction fine-tuning은 모델 간에 일반화를 해줌. 논문에서는 다양한 모델을 사용함으로써 instruction fine-tuning의 일반성을 관찰하였다. 이 발견은 T5 모델 또는 decoder-only LM에서 instruction fine-tuning의 효과를 입증한 이전 연구와 일치한다. 게다가 instruction fine-tuning이 다른 모델에 적용된 기술인 UL2R과도 잘 묶이는 것을 보여줬다. 이 방법을 사용한 모델이 이 논문에서 사용한 가장 강력한 모델인 Flan-U-PaLM이다.

instruction fine-tuning은 사용성을 개선하고 잠재적 위험을 완화함. pre-trained checkpoint를 바로 사용하는 것은 비전문가에게는 어려울 수 있다. 이는 왜냐하면 NSP objective에서 학습된 모델은 언제 생성을 멈추는지 잘 모르고, 질문에 응답하기 보다는 입력을 반복하는 실수를 저지를 수 있기 때문이다. Flan-PaLM은 여러 AI 벤치마크에서 PaLM을 능가하는 모습을 보여줬다. Flan-PaLM의 출력은 다음과 같은 특징을 가진다.

- 더 나은 human rating

- 유해 언어를 측정하는 AI 벤치마크에서 더 나은 성능을 보여줌

instruction fine-tuning은 비교적 계산 효율적임. 모델 사이즈를 늘리는 것은 성능 개선에는 좋지만, 상당한 계산량을 필요로 한다. 따라서 이를 해결하기 위한 계산 효율적 기술을 만들어야 한다: 이러한 기술은 기존의 checkpoint를 활용해서 모델의 추론 비용에 변화가 없게 해야함. instruction fine-tuning은 비교적 적은 양의 계산으로도 성능을 향상시킬 수 있다. 게다가, instruction fine-tuning을 사용하는 더 작은 모델이, 사용하지 않는 더 큰 모델을 능가하는 모습을 보여주기도 한다.

최종적으로 요약하여 위의 증거들은 어떻게 instruction fine-tuning이 다양한 평가에서 성능을 향상시키는지를 보여준다.

출처

https://arxiv.org/abs/2210.11416

Scaling Instruction-Finetuned Language Models

Finetuning language models on a collection of datasets phrased as instructions has been shown to improve model performance and generalization to unseen tasks. In this paper we explore instruction finetuning with a particular focus on (1) scaling the number

arxiv.org