The Problem of Overfitting

$x \in \mathbb{R}$로부터 $y$를 예측하는 문제를 생각해보도록 하자. 아래의 왼쪽 그림은 $y = \theta_{0} + \theta_{1}x$를 데이터셋에 적용시켰을 때의 결과를 보여주고 있다. 그림을 보면 직선이 정확히 점들의 위에 있지 않다는 것을 알 수 있다. 따라서 직선이 점들에 정확히 맞지 않는다는 것을 보여주고 있다.

여기에 추가적으로 feature을 추가하면, $y = \theta_{0} + \theta_{1}x + \theta_{2}x^{2}$을 얻게 되고, 그 전보다 좀 더 데이터에 맞는 함수를 얻게 된다. 이를 미루어 보아, feature가 더 많아지면 더 좋은 결과를 얻을 수 있다는 것을 짐작해볼 수 있다. 하지만, 그렇다고 해서 너무 많은 feature을 추가하는 것도 문제를 발생시킬 수 있다. 오른쪽의 그림을 보면 5차 함수인 $y = \sum_{j=0}^{5} \theta_{j}x^{j}$을 적용시킨 모습이다. 함수를 보면 커브가 모든 점을 완벽하게 지나는 것을 알 수 있다. 하지만, 그렇다고 해서 이 함수가 좋은 예측자가 될 수 있을 거라고는 말할 수 없다. 왼쪽 그림은 모델이 데이터를 잘 캡처하지 못하고 있는데 이를 underfitting이라 한다. 오른쪽 그림은 overfitting의 예시이다.

Underfitting, 혹은 high bias는 hypothesis function $h$가 데이터의 추세를 잘 따라가지 못할 때 사용되는 단어이다. 이는 보통 함수가 너무 간단하거나 적은 feature를 사용할 때 발생한다. 이와 반대로는 overfitting, 혹은 high variance가 있다. 이는 hypothesis function $h$가 데이터에는 잘 맞지만, 새로운 데이터를 잘 예측하도록 정규화되어 있지 않은 경우를 말한다. 이는 보통 데이터와 상관 없는 불필요한 곡선과 각들을 생성해내는 복잡한 함수 때문에 발생한다.

이 용어는 linear와 logistic regression 둘 모두에 적용된다. 다음은 overfitting을 해결하기 위한 두 가지 옵션이다.

- feature의 수 줄이기

- 어떤 feature가 보존될 지 선택

- model selection 알고리즘 사용

- Regularization

- 모든 feature을 유지하지만, 파라미터 $\theta_{j}$의 규모를 줄이기

- 정규화는 약간 유용한 feature가 많은 때 잘 작동

Cost Function

hypothesis function에서 overfitting을 겪으면, 비용을 증가시켜 함수의 일부 항이 갖는 가중치를 줄일 수 있다. 다음의 함수를 좀 더 이차 함수로 변환하고 싶다.

$\theta_{0} + \theta_{1}x + \theta_{2}x^{2} + \theta_{3}x^{3} + \theta_{4}x^{4}$

그러기 위해서는 이 식에서 $\theta_{3}x^{3}$와 $\theta_{4}x^{4}$의 영향력을 제거해야 한다. 이 feature을 완전히 없애거나 hypothesis function의 형태를 바꾸는 대신에, cost function을 조정하였다.

$\theta_{3}$과 $\theta_{4}$의 비용을 증가시키기 위해, 원래의 cost function의 마지막 부분에 추가적으로 항 두 개를 추가가하였다. 이제, cost function의 값이 0에 근접하도록 $\theta_{3}$과 $\theta_{4}$의 값을 0에 가깝게 감소시켰다. 이는 hypothesis function에서 $\theta_{3}x^{3}$과 $\theta_{4}x^{4}$의 값을 크게 줄여준다. 그 결과, 새로운 hypothesis$($핑크색 곡선$)$은 이차 함수로 보여지지만, 매우 작은 $\theta_{3}x^{3}$와 $\theta_{4}x^{4}$ 덕분에 데이터에 더욱 잘 맞는다.

모든 세타 파라미터들을 하나의 최종체로 정규화하였다.

여기서 $\lambda$는 regularization parameter이다. 이것은 세타 파라미터의 비용이 얼마나 증가하게 될 지 결정한다. 위의 cost function과 최종체를 사용해서, hypothesis function의 출력을 부드럽게 해서 overfitting을 줄일 수 있다. 만약 lambda가 더욱 큰 값으로 선택되면, 함수를 너무 부드럽게 만들어버려서 underfitting을 발생시킨다.

Regularized Linear Regression

정규화를 linear regression과 logistic regression 모두에 적용시킬 수 있다. 먼저 linear regression의 방식으로 접근해보자.

Gradient Descent

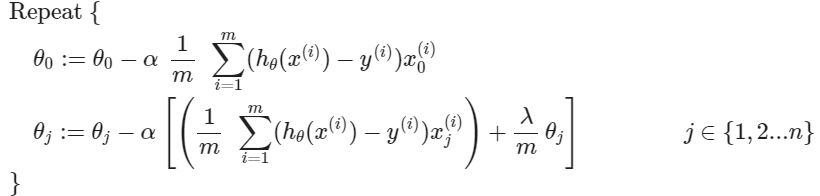

기존의 경사 하강법을 조정해서 $\theta_{0}$을 분리해냈다. 왜냐하면 $\theta_{0}$에 처벌을 가하고 싶지는 않았기 때문이다.

여기서 $\frac {\lambda}{m} \theta_{j}$이 정규화를 수행한다. 몇 개의 조정과 함께 update rule은 다음과 같이 표현될 수 있다.

위 수식의 첫 번째 항인 $1 - \alpha \frac {\lambda}{m}$은 항상 1보다 작은 값을 가진다. 이를 통해 직관적으로 매 업데이트마다 $\theta_{j}$의 값이 줄어든다고 볼 수 있다. 두 번째 항은 이전의 것과 완전히 동일하다.

Normal Equation

이제 비반복 정규 방정식의 대체 방법을 사용하여 정규화에 접근해보도록 하겠다. 정규화를 추가하기 위해, 기존의 방정식과 똑같지만, 괄호 안에 다른 항을 추가시켰다.

$L$은 왼쪽 위에 0이 있고, 그 외의 대각선에는 모두 1인 행렬이다. 이 행렬은 $(n+1) \times (n+1)$의 차원을 가진다. 직관적으로, 이것은 하나의 실수 $\lambda$가 곱해진 단위 행렬이다$(x_{0}$을 포함하지 않을 때$)$.

만약 $m < n$이면, $X^{T}X$는 비반복성이다. 하지만, $\lambda \cdot L$을 더하게 되면, $X^{T}X + \lambda \cdot L$은 비반복성이 된다.

Regularized Logistic Regression

logistic regression도 linear regression을 정규화했던 것처럼 비슷하게 정규화할 수 있다. 그 결과, overfitting을 피할 수 있게 된다. 다음의 그림은 정규화된 함수$($핑크색 선$)$이 어떻게 작동하고, 비정규화 함수$($파란색 선$)$보다 얼마나 덜 overfitting된 지를 보여준다.

Cost Function

logistic regression에 대한 cost function을 기억해보도록 하자.

이 방정식을 마지막 부분에 항을 추가함으로써 정규화할 수 있다.

두 번째 시그마, $\sum_{j=1}^{n} \theta_{j}^{2}$는 편향 항 $\theta_{0}$을 명시적으로 제외함을 의미한다. $\theta$ 벡터는 0부터 n까지 인덱싱되어 있고, 이 시그마는 명시적으로 $\theta_{0}$을 스킵함으로써 0을 스킵해서 1부터 n까지 수행하게 된다. 따라서, 방정식을 계산할 때, 계속적으로 다음의 두 방정식을 업데이트해야 한다.

'Lecture 🧑🏫 > Coursera' 카테고리의 다른 글

| [Machine Learning] Cost Function & Backpropagation (0) | 2023.03.26 |

|---|---|

| [Machine Learning] Neural Networks (0) | 2023.03.20 |

| [Machine Learning] Multiclass Classification (0) | 2023.03.15 |

| [Machine Learning] Classification & Representation (0) | 2023.03.15 |

| [Machine Learning] Computing Parameters Analytically (0) | 2023.03.14 |